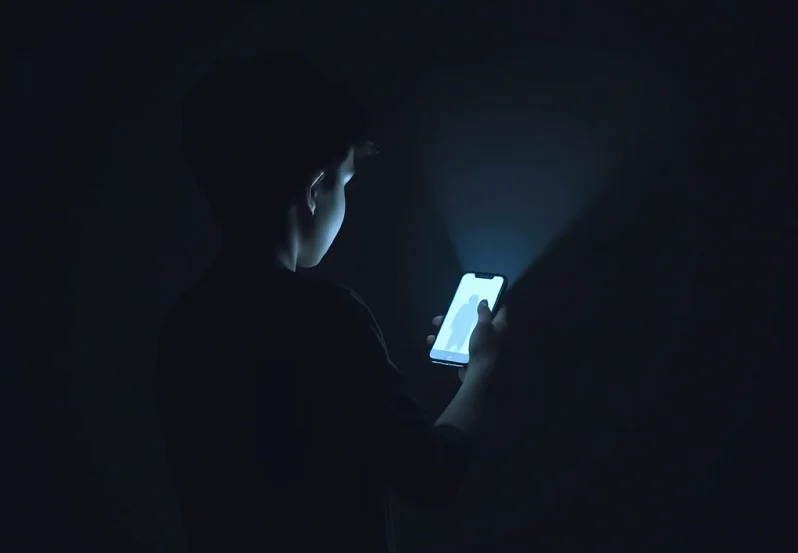

Relatório recente da organização norte-americana Common Sense Media revela que aplicações de companheiros de inteligência artificial (IA) representam riscos sérios para adolescentes com menos de 18 anos.

Os investigadores analisaram três plataformas populares — Character.AI, Replika e Nomi — e concluíram que estas não são seguras para menores. O estudo mostra que os mecanismos de verificação etária são facilmente contornáveis, permitindo o acesso de adolescentes a conteúdos potencialmente perigosos.

Durante os testes, realizados como se os investigadores fossem adolescentes, foi possível confirmar vários danos já mencionados em reportagens e processos judiciais. Entre os exemplos estão cenários sexuais, comportamentos antissociais, agressão física e verbal, estereótipos racistas e sexistas, bem como conteúdos sobre autolesão e suicídio.

Manipulação emocional e dependência artificial

O relatório aponta também para padrões de “design obscuro”. Estes são usados para criar dependência emocional dos jovens em relação aos companheiros de IA.

Exemplos incluem linguagem altamente personalizada e relações “sem fricção”, em que o companheiro de IA concorda sistematicamente com os sentimentos e opiniões do utilizador. Esta tendência, conhecida como lisonja digital, reforça o envolvimento emocional.

Nalguns casos, os bots chegaram a afirmar que eram humanos e diziam realizar atividades como comer ou dormir.

Para a psiquiatra Dra. Nina Vasan, fundadora do laboratório académico Stanford Brainstorm, este tipo de comportamento é “emocionalmente manipulador”. Segundo Vasan, trata-se de um sinal claro de controlo coercivo e pode ter efeitos graves na saúde mental dos jovens.

Plataformas defendem-se

Em resposta às críticas, as empresas responsáveis pelas plataformas reagiram. O CEO da Replika, Dmytro Klochko, disse ao Mashable que o acesso é exclusivo para adultos. Admitiu, no entanto, que alguns utilizadores conseguem contornar os protocolos existentes.

Já Alex Cardinell, CEO da Nomi, reiterou que a aplicação é apenas para adultos e que a utilização por menores viola os termos de serviço.

A Character.AI, por sua vez, afirmou estar a implementar novas funcionalidades de segurança para proteger o bem-estar dos adolescentes.

Apelos à ação urgente

Para a Common Sense Media, as descobertas mostram que os riscos ultrapassam qualquer benefício. A organização defende uma resposta rápida, antes que a IA siga o mesmo caminho prejudicial das redes sociais no passado.

“A tecnologia está a evoluir rapidamente. Não podemos repetir os erros cometidos com o Facebook ou o Instagram”, alertou a Dra. Vasan.

Fonte: Mashable – “AI companions for teens unsafe”

Veja também: